마지막 수정

정적 사이트 robots.txt를 안전하게 운영하는 기준

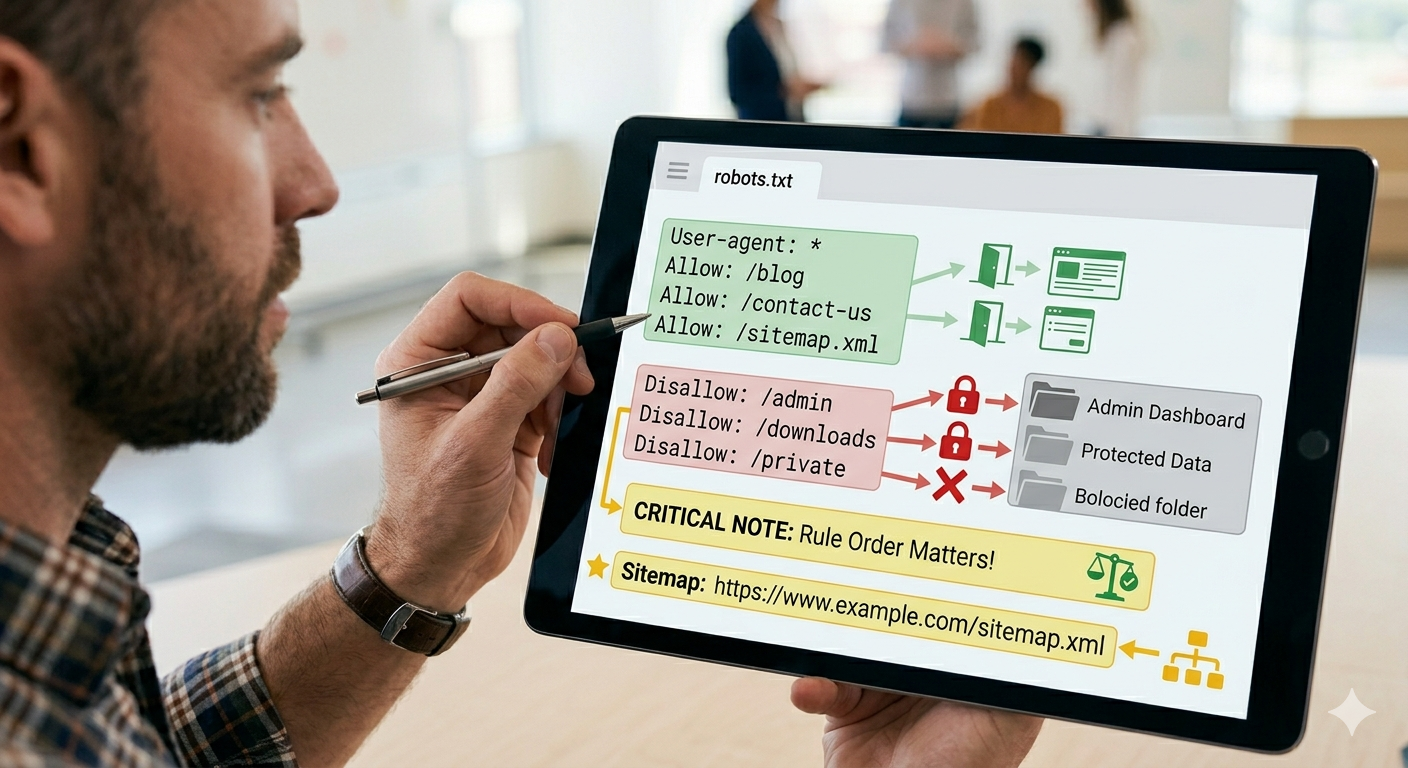

정적 사이트에서 robots.txt는 작고 단순해 보여서 쉽게 넘기기 쉽다. 그런데 바로 그 점 때문에 큰 실수를 만든다. 한 줄만 잘못 막아도 전체 콘텐츠가 검색에서 사라지거나 필요한 경로가 크롤링되지 않을 수 있다.

후속 점검 글은 정적 웹사이트 운영 유닛 페이지를 기준으로 인덱싱, 자산, 도메인, 배포 흐름으로 이어가면 된다.

1. robots는 비공개 장치가 아니라 크롤링 규칙이다

가장 먼저 잠글 기준은 목적이다. robots.txt는 크롤러에게 무엇을 요청하지 말라고 말하는 파일이지, 비공개 보호 장치가 아니다.

2. 생각보다 덜 막아야 한다

기술적으로 보인다는 이유로 폴더를 넓게 막는 경우가 많다. 하지만 템플릿, 자산, locale 경로, generated 페이지까지 같이 막히면 검색 흐름 전체가 틀어질 수 있다.

3. sitemap 줄은 기본선으로 넣는다

검색 유입을 운영할 생각이라면 sitemap 줄은 기본 구성으로 봐야 한다. live sitemap URL을 가리키는 줄이 항상 포함돼 있어야 한다.

User-agent: *

Allow: /

Sitemap: https://example.com/sitemap.xml4. 로컬 파일이 아니라 live 응답을 확인한다

정적 사이트 운영에서는 로컬 파일이 맞아도 배포 호스트가 다른 응답을 줄 수 있다. 배포 후에는 항상 live robots URL을 직접 열어서 확인해야 한다.

무엇부터 시작할까

지금 robots.txt를 보면서 한 가지만 먼저 물어보면 된다. 검색이 계속 필요한 경로를 혹시 막고 있지 않은가. 그 답이 불분명하면 아직 운영 규칙이 약한 상태다.